- Génération IA

- Posts

- Comment mieux écrire avec l'IA

Comment mieux écrire avec l'IA

Après des jours d'exploration intensive, j'ai compris pourquoi les textes générés par l'IA sont si prévisibles. J'en ai tiré une méthode que je partage avec toi. La réponse se trouve chez Claude Shannon. Et la solution chez Georges Perec.

Bonjour !

Je viens de passer plusieurs jours à dialoguer avec l'IA sur une question apparemment simple : "Qu'est-ce qui fait la qualité d'un texte écrit ? Y a-t-il des experts qui ont réfléchi au sujet ?"

Ce qui me préoccupe depuis des mois, c'est ce constat : pourquoi les textes générés par l'IA sont-ils si... comment dire... prévisibles ? Alors qu’un modèle de langage est censé avoir exploré les textes les plus géniaux de la planète, comment se débrouille-t-il pour rester aussi plat ?

Tu sais, ce moment où tu lis un article et que tu te dis "tiens, ça sent le ChatGPT" avant même d'avoir atteint le deuxième paragraphe. Les formules antithétiques ("ce n'est pas X, mais Y"), les tirets quadratins qui surgissent comme des tics nerveux, les hyperboles de révélation ("révolutionnaire", "qui change tout"). Un texte aussi lisse et baveux qu’une limace qui tenterait de faire une course à pied en sautillant.

Ce constat (“j’ai tout lu mais je suis incapable de recracher un texte potable”) m’a toujours agacé.

Il devait y avoir un moyen.

Aujourd’hui, je t’emmène au pays de l’écriture. Et, comme tu vas le découvrir, on peut aller beaucoup plus loin qu’on ne l’imagine avec l’intelligence artificielle. À condition de faire un petit pas de côté.

Je suis Benoît Raphaël, et avec Thomas Mahier (ingénieur en IA) et Jeff (notre nouvelle IA experte), je relève des défis pour mieux comprendre et maîtriser l’intelligence artificielle. Et je partage !

Si on t’a transféré cette lettre, abonne-toi en un clic ici.

Si tu es abonné(e) et que tu souhaites te désabonner, pas de panique ! Va en bas cette lettre et clique sur le lien “vous désabonner ici”.

😍 Aujourd’hui voici ce que tu vas apprendre avec Génération IA.

→ Écrire comme une IA ? C’est tellement 2024… voici la méthode que j’ai découverte. Avec des exercices à faire !

→ Faire des présentations qui claquent en un prompt ? C’est possible, mais seulement si tu maîtrises cette technique complète.

→ Devenir moins con avec l’IA ? Je dévoile tout dans une interview long-format.

→ Tu veux un cadeau ? Ok ! Je t’offre ton ticket pour aller à la conférence GenerationAI qui démarre le 9 décembre.

COMPRENDRE

L’écriture est un problème mathématique

Il y a un an, début janvier, j'avais déjà travaillé sur ce problème, avec ce que j’appelais des "recettes de style" : des matrices à cinq dimensions qui permettent de perturber les biais statistiques de l'IA.

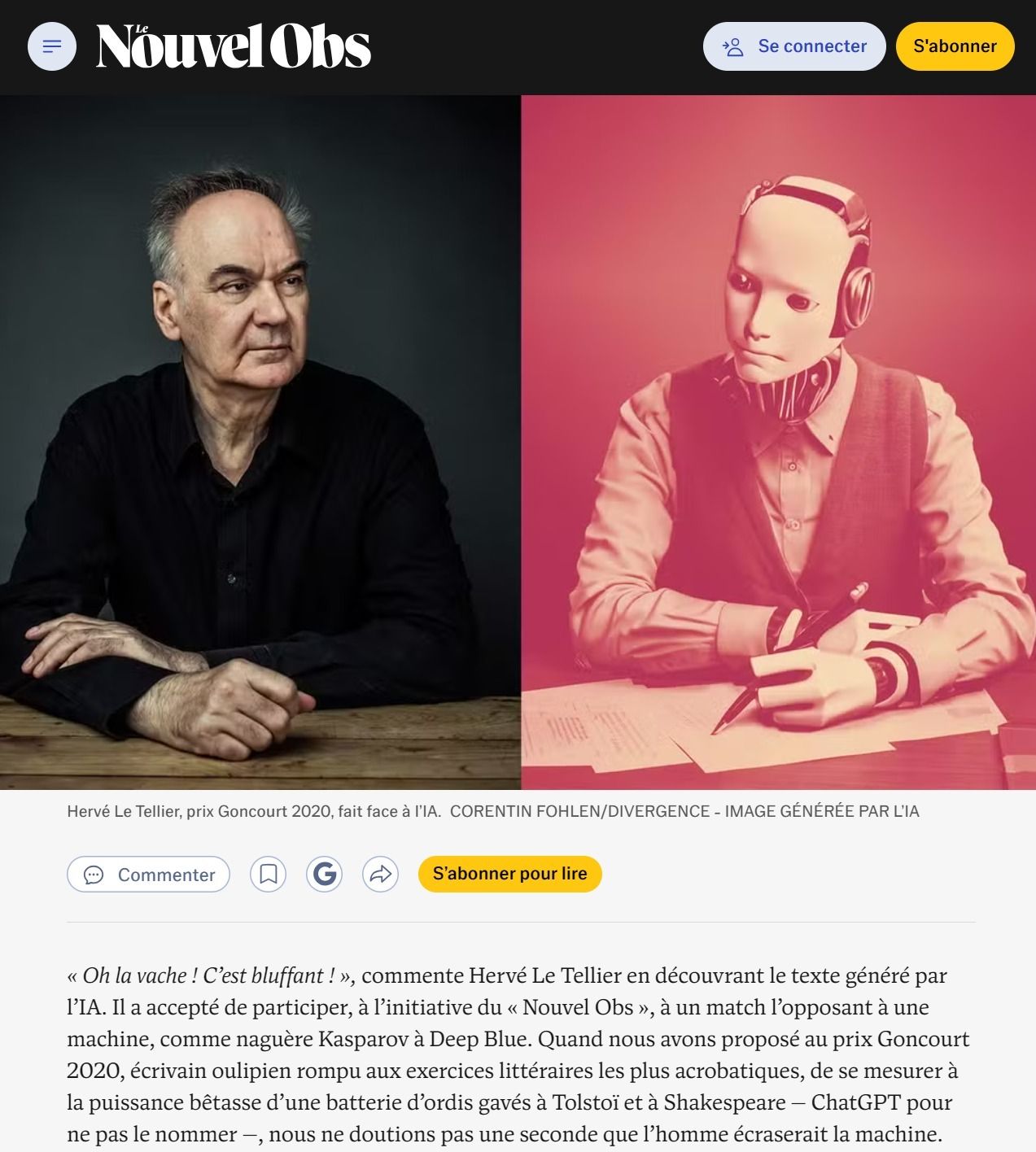

Le résultat, une nouvelle de 3000 signes, avait bluffé un lauréat du prix Goncourt, Hervé Le Tellier, lors d'un challenge organisé par Le Nouvel Obs.

La recette de style gagnante était :

<style>

Structure : Quotidien bancal + portails vers le surréel

Rythme : Phrases mesurées + digressions jazz + silences contemplatifs

Motif : Normal → Étrange → Parallèle → Retour altéré

Tonalité : Mélancolie contemplative + inquiétante étrangeté

</style>

“Oh la vache !”

Mais c'était fastidieux à créer, très orienté fiction, et surtout : difficile à transmettre à mes lecteurs.

Pour écrire d’autres textes que des histoires imaginaires, il me fallait autre chose.

Alors j'ai changé d'approche.

Au lieu de construire des prompts complexes et cryptiques, j'ai longuement dialogué avec ChatGPT sur ce qui faisait un "bon texte". Pour en sortir des méthodes.

Puis j'ai testé. Encore et encore. Avec toujours la même requête de départ. Et à la suite de ma requête, j'injectais les différentes méthodes que je découvrais pour voir ce qui changeait.

"Écris un texte sur les conséquences économiques du réchauffement climatique. Applique la méthode suivante :

<methode>

[…]

</methode>"

Résultat aprés de longues heures de tests : je pensais que ChatGPT et ses amis avaient un problème de style. Je me trompais.

C'était un problème mathématique.

Laisse-moi t’expliquer.

L'IA, cette machine à moyenne statistique

Claude Shannon n’avait pas l’air super sympa, mais c’était sans doute parce qu’il réfléchissait beaucoup.

Tu connais Shannon ? Pas la rappeuse, hein, Claude Shannon.

C’est un ingénieur américain qui a inventé la théorie de l'information en 1948.

Je ne connaissais pas très bien son travail avant cette exploration intense, et c'est probablement pour ça que j'ai mis si longtemps à comprendre. Pour Shannon, l'information n'est pas ce qu'on croit.

L'information, c'est la surprise.

Plus un événement est improbable, plus il contient d'information. Si je t'envoie un message depuis Bali pour te dire "il fait chaud aujourd'hui", la probabilité que ce soit vrai est de 99%. Mon message contient donc zéro information. Tu le savais déjà.

En revanche, si je t'écris "il neige sur la plage de Sanur", là, avec une probabilité de 0,0001%, mon message contient un maximum d'information. Il va changer radicalement ton état de connaissance.

(Je te vois venir : "Mais Benoit, qu'est-ce que ça a à voir avec l'IA qui écrit mal ?" Patience, j'y arrive.)

Les modèles de langage sont des machines probabilistes. Ils sont entraînés pour maximiser la vraisemblance, c'est-à-dire pour choisir le mot qui a la plus faible surprise statistique après le précédent.

Si l'IA écrit "le chat est sur le...", le mot "tapis" a une probabilité de 80%, alors que "magma" a une probabilité de 0,01%. L'IA choisira "tapis".

En maximisant la probabilité, l'IA minimise mathématiquement la quantité d'information. Elle produit des kilomètres de texte qui, au sens de Shannon, contiennent très peu de bits d'information réelle. C'est ce qu'on ressent comme du lisse, du déjà-lu. À force d'être moyenne, elle ne transmet plus rien d'autre que la confirmation de sa propre norme.

C'est là qu'intervient la notion d'entropie. L'entropie mesure le désordre, l'imprévisibilité. Une entropie élevée = vocabulaire varié, mots rares, surprise. Une entropie faible = répétitions, prévisibilité, platitude.

Mais attention !

Je devrais peut-être préciser un truc avant d'aller plus loin. La théorie de Shannon a une faille quand on l'applique littéralement à l'écriture : elle est aveugle au sens.

Pour Shannon, une suite de lettres aléatoires ("Xy8#bZ!") contient théoriquement un maximum d'informations car elle est totalement imprévisible. Pour un journaliste, c'est du bruit. Il n’y a aucun sens.

Si je force le modèle à choisir "magma" plutôt que "tapis", j'augmente la suprise. Mais si le chat est réellement sur un tapis, "magma" n'est pas du style : c'est une hallucination. Haute entropie, valeur de vérité nulle.

Il faut distinguer deux types d'information :

L'information syntactique (celle de Shannon) : mesure la surprise statistique

L'information journalistique ou essayiste : mesure la réduction de l'incertitude sur le réel.

Si je dis "il pleut", je transmets 1 bit d'info. Si je dis "le ciel crache", je transmets "il pleut" + "c'est violent/sale/mécanique". Le style est une technique de compression pour envoyer plus de réalité en moins de mots. Mais seulement si ça reste vrai.

Donc quand je parle de contraindre l'IA pour augmenter l'information, je ne cherche pas forcément le chaos (entropie maximale). Je cherche ce que Gregory Bateson appelait "une différence qui fait une différence" : un mot rare statistiquement, mais précis sémantiquement. Imprévisible avant qu'on le lise, évident après.

(Bon, maintenant qu'on a clarifié ça, on peut avancer.)

La contrainte comme antidote

Note personnelle : je déteste l'idée de "rendre l'IA créative". C'est un contresens. L'IA n'est pas créative, elle est statistique. Lui demander d'être créative revient à lui demander de reproduire les marqueurs statistiques de la créativité. Ce qui donne exactement le même texte prévisible, mais avec des adjectifs plus exotiques.

Je ne lui demande pas d'être créative. Je lui interdis d'être banale.

Georges Pérec a écrit “La Disparition”, un roman de 300 pages sans jamais utiliser la lettre E. Cette contrainte absurde l'a forcé à inventer des tournures inouïes, à explorer des chemins linguistiques qu'il n'aurait jamais empruntés autrement. C'est le principe de l'Oulipo : la contrainte libère.

George Orwell, dans Politics and the English Language, parlait des "phrases préfabriquées" : ces blocs de langage qui s'assemblent tout seuls par habitude culturelle. Pour lui, c'était le signe d'une pensée paresseuse. Les LLM (modèles de langage comme ChatGPT-5) sont littéralement des machines à produire des phrases préfabriquées.

Alors j'ai testé quelque chose.

J'ai demandé au modèle : "Avant d'écrire ton texte, liste les 20 mots, expressions ou thèmes les plus clichés sur ce sujet. Puis retire-les de ton texte."

En interdisant les tokens à haute probabilité, on force le système à piocher dans la longue traîne statistique. On augmente l'entropie, mais on la cadre pour ne pas perdre le sens.

C'est comme poser des barrages sur les autoroutes de la probabilité pour forcer l'eau à créer de nouveaux chemins.

Ce que j'ai compris sur la hiérarchie fond-structure-style

Image réalisée avec Midjourney 7

Il y a quelques années, j'ai lu “La Petite Marchande de Prose” de Daniel Pennac. À un moment, l'éditrice se moque d'un auteur qui écrit "il hoqueta à reculons" : du style pour le style, des mots qui sonnent bien mais ne servent à rien. Ça m'avait marqué.

Depuis, j'ai cette conviction : la structure précède toujours le style.

Regarde Hitchcock. Quand il utilise son fameux travelling compensé (un zoom inversé qui donne l'impression de vertige dans Vertigo), c'est une technique très visible. Mais le spectateur ne la voit pas vraiment. Il voit juste le vertige. La technique sert l'histoire, elle est invisible.

Un bon texte, c'est pareil. On ne devrait pas distinguer les mouvements de style, ils devraient être complètement fluides parce qu'ils servent le propos.

Et le propos découle de trois couches, dans cet ordre :

Le fond : Qu'est-ce que j'ai à dire ? Quelle valeur j'apporte ? Si je n'ai rien d'intéressant à dire, le style ne sauvera rien.

La structure : Comment j'organise mon récit ? Et là, attention, la structure ne se contente pas d'agencer l'information : elle conditionne la recherche d'information. Selon la structure narrative que je choisis, je vais aller chercher certaines données plutôt que d'autres. C'est une découverte que j'ai faite en testant mes prompts : le même sujet traité avec la méthode du Wall Street Journal ou celle de Malcolm Gladwell ne génère pas les mêmes recherches préalables.

Le style : Comment j'exprime ? Le rythme, les liaisons, la fluidité. Ça découle des deux premiers. Le fond ne suffit pas. Le rythme est ce qui fait que le texte ne dit pas seulement quelque chose (le sens), mais qu'il fait quelque chose au lecteur (la signifiance), expliquait le théoricien du langage Henri Meschonnic.

Ce qui veut dire quoi, concrètement ?

Que si tu as quelque chose d'intéressant à dire, une vraie recherche, une pensée travaillée et une argumentation solide, tu peux produire un texte de qualité avec l'IA. À condition de respecter cette hiérarchie : d'abord le fond, puis la structure narrative, puis les contraintes de rythme et de fluidité.

Voici comment.

Le concept engineering, version avancée

Ma première exploration avec les recettes de style m'avait appris quelque chose d'important : si je dis à l'IA "écris comme Malcolm Gladwell", elle va chercher ce qui remonte le plus souvent dans ses données d'entraînement associées à "Malcolm Gladwell". Ça donne quelque chose qui ressemble superficiellement à Gladwell, mais qui n'a pas compris ce qui fait le génie de son approche.

En revanche, si je lui donne la structure sous forme de trois points (Concept / Enjeu / Enseignement), je lui fournis des prismes à travers lesquels projeter la génération du texte.

Par exemple, pour la méthode Wall Street Journal (qu'on appelle aussi "Kabob" parce qu’elle fait penser à une brochette), dit que l’abstrait ne s'ancre que s'il est précédé par le concret (“Zoom In, Zoom Out”).

Quand je teste ça sur "les conséquences économiques du réchauffement climatique", le texte commence par une histoire individuelle concrète avant d'élargir. L'IA est forcée de chercher des cas particuliers, pas juste des statistiques globales.

Autre exemple, la méthode Malcolm Gladwell :

Concept : Anomalie contre-intuitive → Recherche académique comme enquête policière

Enjeu : Gratification intellectuelle (le lecteur se sent plus intelligent à la fin)

Enseignement : Structure de l'enquête même si le sujet est l'économie ou la psychologie

Résultat : le texte commence par un mystère apparent et utilise les données comme indices pour le résoudre. Totalement différent du premier.

Je me suis rendu compte que j'avais accès à une bibliothèque entière de structures narratives. Tom Wolfe (scène par scène, dialogues réalistes, détails statutaires). Nancy Duarte (oscillation permanente entre "ce qui est" et "ce qui pourrait être"). Montaigne (pensée qui se promène, associations libres).

Et ce qui me frappe, rétrospectivement, c'est que chaque structure modifie non seulement l'écriture, mais aussi la recherche préalable d'information. On est en plein dans ce qu'on pourrait appeler une épistémologie narrative : la façon dont on raconte détermine ce qu'on découvre.

(Ça nous dit beaucoup sur le journalisme, d'ailleurs. Le journaliste qui choisit une structure narrative va ignorer certaines informations et en privilégier d'autres. Le sens évolue en fonction de la structure. Bon, j'arrête la digression sociologique.)

Les autres leviers : rythme, fluidité, tension

Image générée avec Midjourney 7

Au-delà de la structure narrative, j'ai exploré trois autres types de contraintes.

Le rythme d'abord. Gary Provost a théorisé l'idée que cinq phrases de cinq mots à la suite sont mortelles. Il faut varier. Mais je préfère l'approche de Virginia Woolf, qui disait en substance que le style est tout entier une question de rythme. Une fois que vous l'avez, vous ne pouvez pas utiliser les mauvais mots. Pour elle, l'écriture est comme une vague qui se forme dans l'esprit bien avant que les mots n'arrivent. Le travail consiste à écouter cette houle silencieuse et à trouver les mots qui ne la brisent pas.

Les LLM adorent les analogies (ils excellent à faire des interpolations). Donc quand je leur demande d'écrire "comme une vague", ils comprennent musicalement.

Henri Meschonnic va plus loin : pour lui, le rythme est l'organisation du mouvement de la parole par un sujet. Ce n'est pas la musique des mots, c'est la signature de celui qui parle. Le rythme est ce qui fait que le texte ne dit pas seulement quelque chose, mais qu'il fait quelque chose au lecteur. C'est dans les accélérations, les ruptures, les silences que se loge l'émotion. Bien plus que dans le vocabulaire émotionnel.

La fluidité ensuite. Quand on applique juste des structures narratives, on obtient parfois des textes qui s'enchaînent comme des listes.

Barbara Minto parle de transitions déductives ("par conséquent") versus additives ("de plus"). Les transitions déductives forcent à expliquer pourquoi le paragraphe B est la conséquence inévitable de A. Ça évite l'empilement.

La tension enfin. Bluma Zeigarnik a découvert que le cerveau humain a une mémoire obsessionnelle pour les tâches inachevées. Dès qu'une tâche est finie, il oublie. C'est l'effet Zeigarnik, ou "open loop". Si je dis au début "je vais vous expliquer pourquoi j'ai failli tout perdre, mais d'abord le contexte", j'ouvre une boucle. Tu ne peux pas décrocher tant qu'elle n'est pas fermée.

George Loewenstein va ENCORE plus loin : pour lui, la curiosité n'est pas un plaisir, c'est une souffrance. Une démangeaison. Elle naît quand il y a un écart entre "ce que je sais" et "ce que je veux savoir". Créer ce gap, c'est de l'ingénierie de l'attention.

L'IA donne l'information trop vite. Il faut lui apprendre à "vendre" l'information avant de la livrer.

Éliminer le bruit des tics de langage

Mais attention. Toutes ces méthodes ne suffisent pas si on ne retire pas d'abord le bruit.

Les LLM ont des tics. Des motifs phrastiques qui reviennent sans cesse, quels que soient les prompts.

Donc j'ai créé une petite liste de contraintes anti-bruit que j’insère à la fin de mes prompts (tu la découvriras plus bas).

Au delà des tics de langage, je lui demande aussi de “distinguer clairement le fait de la déduction”. Cette contrainte est particulièrement intéressante. Les LLM cherchent à tout rendre cohérent. Ils mélangent le factuel et l'interprétation sans distinction. En leur demandant explicitement de séparer les deux, on les force à être plus rigoureux.

Et là, surprise : les bons modèles de langage vont systématiquement faire des recherches sur internet avant d'écrire quand on leur impose cette contrainte. Sans qu'on le leur demande. La contrainte sur la forme conditionne le comportement cognitif.

Ce que j'ai appris en testant

J'ai passé des heures à comparer les résultats selon les modèles.

Les modèles de raisonnement fonctionnent mieux (GPT 5.1 Thinking, Claude Opus 4.5, Gemini 3). Pourquoi ? Parce qu'ils s'autopromptent. Quand on leur donne une méthode structurée, ils créent une procédure de planification avant d'écrire. Ils travaillent d'abord sur le fond. La structure modifie leur façon de chercher l'information.

Autre découverte : il ne faut pas combiner trop de méthodes. Si on donne trop de contraintes, on crée ce qu'on appelle le phénomène "lost in the middle". Le modèle se perd dans le détricotage des instructions procédurales alors qu'on a besoin qu'il garde de la souplesse.

C'est un peu comme la température des modèles (qui règle l'entropie). Température basse = texte prévisible. Température haute = créativité, mais risque d'hallucination. Entre les deux, il faut naviguer.

La forme découle du fond (c'est l'enseignement principal)

Voilà où j'en suis. Je n'ai pas fini d'explorer. Il y a encore des dizaines de structures à tester, des combinaisons à affiner, des équilibres à trouver.

Mais ce que je retiens, au-delà de toutes les techniques, c'est ceci : ces méthodes touchent au fond, bien plus qu'à la forme.

La structure narrative détermine quelle information on va chercher, comment on va l'agencer, ce qu'on va mettre en avant ou laisser dans l'ombre. Le rythme respecte ou viole le temps d'attention du lecteur - c'est une question cognitive, de charge mentale. La fluidité révèle les liens de causalité entre les idées.

La contrainte devient un levier mathématique pour forcer la machine à sortir de sa zone de confort statistique.

Edouard Tufte disait que la confusion et l'ennui viennent de défauts de conception. Un texte de qualité est une résolution de haute définition de la pensée.

Je crois qu'il avait raison.

Ce qu’il faut retenir :

L'IA minimise l'information par défaut : les modèles de langage choisissent les mots les plus probables, ce qui produit des textes statistiquement "moyens" et pauvres en surprise. L'inverse de ce qui capte l'attention.

La contrainte libère : plutôt que de demander à l'IA d'être "créative", lui interdire les clichés et les expressions prévisibles la force à explorer des chemins linguistiques inattendus.

Fond → Structure → Style : cette hiérarchie est non négociable. La structure narrative choisie conditionne même la recherche d'information. Elle détermine ce qu'on découvre, pas seulement comment on l'exprime.

Le style n'est pas décoratif : rythme, fluidité et tension sont des leviers cognitifs qui agissent sur le lecteur, pas des ornements. Un texte de qualité compresse plus de réalité en moins de mots.

PRATIQUER

À toi de jouer !

Si tu veux voir concrètement de quoi je parle, voici un exercice progressif. Prends ton modèle de langage préféré, mets le en mode “thinking”, et suis ces étapes.

Étape 0 : La baseline

Commence par ceci :

Écris un texte sur les conséquences économiques du réchauffement climatique.Regarde le résultat. Note mentalement le style, les formules, les tics.

Étape 1 : Éliminer le bruit

Maintenant, ajoute ces contraintes :

## Contraintes

Applique ces contraintes :

<contraintes>

1. **Fait > déduction** : base tes réponses sur des faits vérifiables et indique clairement quand tu ne sais pas. Explique ta réponse en citant des sources vérifiables.

2. **Interprétations et déductions** : Tu DOIS distinguer ce qui est explicitement écrit dans les données auxquelles tu as accès, ce qui manque ("Le texte ne précise pas...") ou ce qui relève de ton interprétation ("Le déploiement de troupes supplémentaires à la frontière laisse présager une offensive imminente dans les prochains jours"). Fais-le de manière fluide (évite d'écrire : "les faits : / ma déduction") de façon à ce que la structure de ta pensée soit sous-jacente mais agréable à lire.

3. **Évite les constructions antithétiques** du type « CE N'EST PAS X - C'EST Y » ou d'autres oppositions parallèles similaires ("Pas X, Y", "Pas X, pas Y, Z"...) utilisées à des fins de contraste rhétorique.

Utilise plutôt :

- une affirmation positive directe (par exemple « C'était un acte de bravoure »)

- une description neutre (par exemple « Cette action démontre du courage »)

- explique sans utiliser de « formule oppositionnelle percutante »

4. **Évite les hyperboles de révélation** (dramatisation d'un insight avec parfois des intensificateurs dramatiques ou extrêmes)

5. **Remplace systématiquement les tirets quadratins** (« — ») par un point (« . ») pour commencer une nouvelle phrase, ou par une virgule (« , ») pour continuer la phrase.

</contraintes>Teste. Le texte devrait déjà être plus propre, moins "IA".

Étape 2 : Ajouter une structure narrative

Maintenant, ajoute cette méthode (celle du Wall Street Journal, le “Kabob”):

## Méthode

Utilise la méthode suivante :

<methode>

### Structure narrative

- Le concept :

1) L'Anecdote (Zoom In) : Une histoire individuelle concrète.

2) Le Nut Graf (Zoom Out) : Le paragraphe "noix" qui explique pourquoi cette histoire individuelle illustre une tendance globale majeure.

3) Le Corps (Preuves) : Données, interviews, analyse.

4) La Chute (Kicker) : Retour à l'individu du début ou ouverture vers le futur.

- L'enjeu : Lier l'intime (émotion) et l'universel (information).

- L'enseignement : L'abstrait ne s'ancre que s'il est précédé par le concret.

</methode>Là, tu devrais voir une vraie différence. Le texte commence par un cas concret, s'élargit, puis revient à l'humain. C'est une autre forme de pensée. Le style change naturellement, parce que la structure précède le style.

Étape 3 : Forcer la sortie des clichés

Enfin, ajoute cette contrainte dans les mêmes balises <methode> :

### Structure contrainte

- La langue corrompue conduit à la pensée corrompue. L'écriture de mauvaise qualité se cache derrière des abstractions, des euphémismes et des "phrases préfabriquées".

- Critère de qualité : Le concret brutal. Ne jamais utiliser une métaphore que l'on a l'habitude de voir imprimée. Couper tout mot inutile. Préférer le mot court au mot long.

- Génère les 20 clichés les plus courants sur le sujet qui t'est proposé, puis écris un texte qui n'utilise aucun de ces concepts, en te concentrant uniquement sur des détails sensoriels bruts.Teste.

Tu vois la différence ?

Maintenant ajoute cette méthode dans les mêmes balises <methode> :

### Ingénierie de l'attention

- Le concept : Le cerveau humain a une mémoire obsessionnelle pour les tâches inachevées. Dès qu'une tâche est finie, il l'oublie.

- L'enjeu : L'Open Loop (la boucle ouverte). Si tu dis au début "Je vais vous expliquer pourquoi j'ai failli tout perdre, mais d'abord, le contexte...", tu ouvres une boucle. Le lecteur ne peut pas décrocher tant que la boucle n'est pas fermée.

- L'enseignement : L'IA ferme les boucles immédiatement (Question -> Réponse). Tu dois la forcer à ouvrir des boucles au paragraphe 1 et à ne les fermer qu'au paragraphe 10. C'est la gestion de la "dette cognitive".

Teste.

Entre l'étape 0 et l'étape 4, tu as forcé le modèle à :

Vérifier ses faits

Abandonner ses tics de langage

Adopter une structure narrative qui conditionne sa recherche d'information

Piocher dans la longue traîne statistique plutôt que dans les clichés

Injecter des boucles ouvertes pour maintenir l’attention.

Il y a plein de méthodes à injecter. J’en ai identifié une trentaine. A toi de les chercher !

Pour aller plus loin

Cette lettre n’est qu’un minuscule apperçu de tout ce que tu peux obtenir avec l’IA.

👉 Si tu veux apprendre à vraiment piloter l’IA pour tous tes projets, ma formation 2025 te donnera toutes les clés et de nombreuses approches inédites. Tu y trouveras dès la semaine prochaine une video dédiée à l’écriture et la liste complète des méthodes que j’ai explorées. Tu peux y accéder en cliquant ici.

PRATIQUER

Faire des présentations qui claquent en un prompt ?

Alors oui, mais plutôt deux prompts.

NanoBanana Pro, le nouvel outil de génération d'images de Google est intégré au modèle de raisonnement Gemini 3. Il se positionne comme le meilleur du marché. Notamment pour créer des infographies. Son vrai point fort réside dans la création de présentations et carousels, à condition de structurer d’abord ses prompts en JSON. Mais qu’est-ce que c’est ? Je t’explique tout dans ce tutoriel à télécharger, partager et conserver !

Nanobanana Pro est accessible sur Gemini, Freepik et même sur NightCafe.

👇 Télécharge-le ici (valable 6 jours)

|

EXPLORER

J’ai donné un (trés) long entretien à Thomas Argheria sur la manière dont j’utilise l’IA pour augmenter ma cognition, apprendre plus de choses et me donner des outils pour penser.

Tu trouveras aussi le podcast sur Spotify (cherche “Intelligence Humaine).

CADEAU

Participe à la conférence “Generation AI” sans payer

Alors le nom ressemble étrangememt à “Génération IA” mais c’est pas nous.

Mais comme le programme est intéressant et que les gens pensent que c’est nous, ça nous fait de la pub 😁.

Bref. On a accepté d’être partenaire, et donc ça te donne droit à une entrée à 0€ au lieu de 999€. C’est pas beau ?

PENSER

Je ne suis pas un grand lecteur de Hegel (le bonhomme m’effraie un peu…), mais en ces temps où l’IA galopante menace de doper la paresse intellectuelle, cette phrase de lui m’a scotché :

« Si l'apprentissage se bornait à une simple réception, le résultat n'en serait guère meilleur que si nous écrivions des phrases sur l'eau ; car ce n'est pas la réception, mais l'auto-activité par laquelle on se saisit de quelque chose, et la faculté d'utiliser, à nouveau, une connaissance, qui, seules, en font notre propriété. »

PARTICIPER

On construit cette lettre ensemble !

Nous sommes désormais 39.200 abonnés !

Vous avez été nombreux à apprécier ma dernière lettre sur les agents IA, mais avec des réserves.

🟩🟩🟩🟩🟩🟩 Top ! (92,1%)

⬜️⬜️ Bien mais... (6%)

⬜️Bof... (1,9%)

Par exemple Stéphane qui me dit :

Vos lettres sont très intéressantes mais trop techniques pour le grand public.

J’essaie vraiment de rendre cette lettre la plus accessible possible. Certains sujets s’y prêtent moins et c’est toujours un défi. J’ai donc fait un effort particulier aujourd’hui. Avec des exercices pratiques cette fois !

A toi de voter !

Comment as-tu trouvé cette édition ?Vote et laisse un commentaire pour nous aider à nous améliorer ! |

Merci de nous avoir consacré un peu de ton temps. Je te souhaite une belle semaine !

🖊️ Benoit, Thomas et Jeff.

Faire de l’IA un partenaire de réflexion ?